Standarde concurente ar putea să apară în curând pe măsură ce companii precum Microsoft, Intel, Qualcomm și Apple se pregătesc să promoveze PC-uri și alte dispozitive care priorizează operațiile AI la nivel local. Microsoft și Intel au recent conturat ceea ce cred ele că ar trebui să fie clasificat ca un „PC AI”, dar liderul actual al sectorului de AI, Nvidia, are idei diferite.

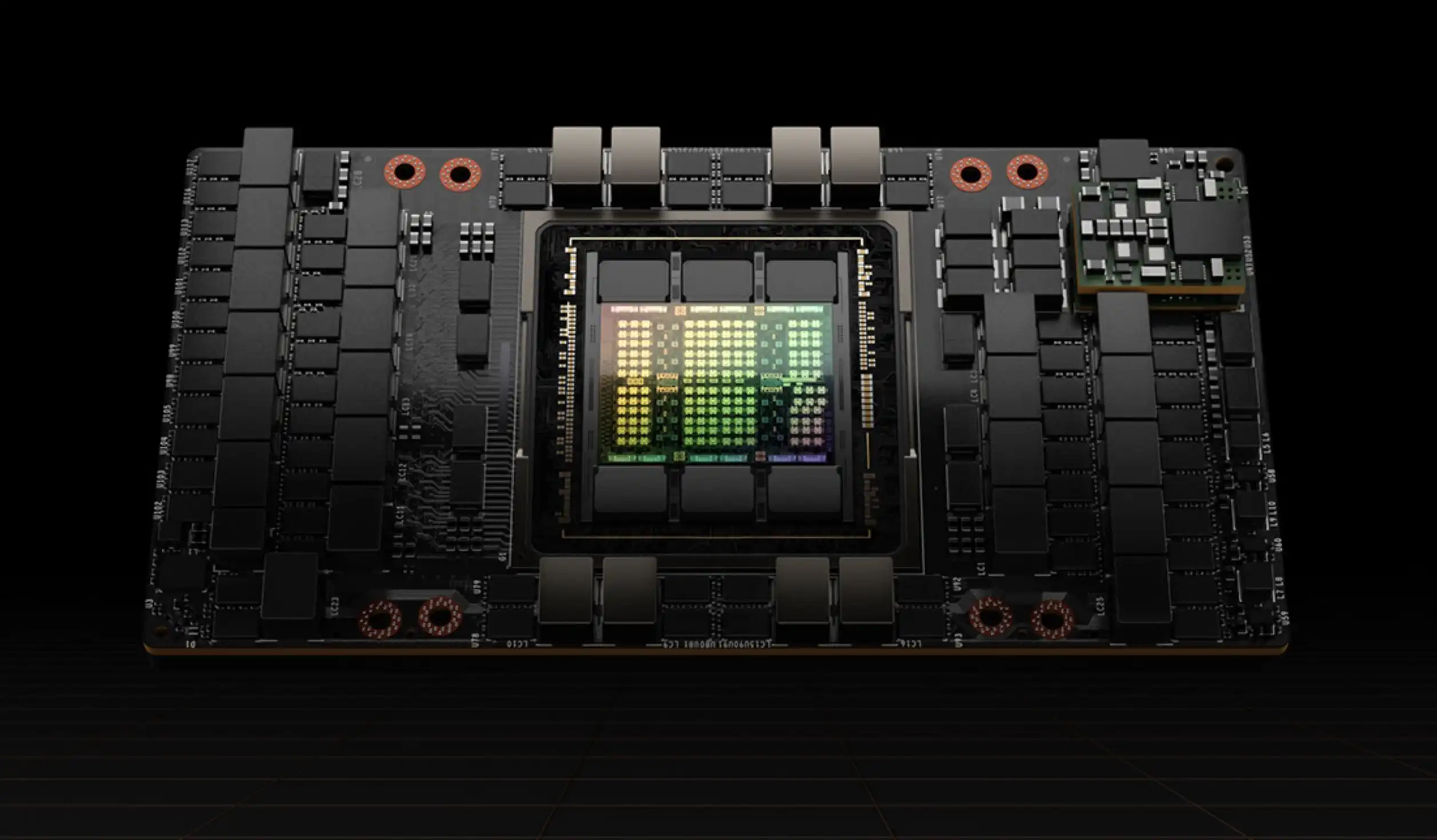

O prezentare internă recent scursă de la Nvidia explică preferința aparentă a companiei pentru GPU-urile discrete în detrimentul NPUs (Unități de Procesare Neurală) pentru rularea aplicațiilor locale generative AI. Gigantul de carduri grafice ar putea vedea NPUs de la alte companii ca o amenințare, deoarece câștigurile sale au crescut rapid odată cu integrarea procesorilor săi în funcționarea modelelor de limbaj mari.

De la lansarea procesorilor săi Meteor Lake la sfârșitul anului trecut, Intel a încercat să promoveze laptopuri cu procesoarele lor și NPUs-ul lor încorporat ca o nouă clasă de „PC AI” proiectată să efectueze operațiuni AI generative fără a se baza pe centre de date masive în cloud. Microsoft și Qualcomm plănuiesc să introducă mai multe PC-uri AI pe piață mai târziu în acest an, iar Apple se așteaptă să se alăture mișcării în 2024 cu procesoarele sale M4 și A18 bionic.

Microsoft încearcă să-și promoveze serviciile ca fiind esențiale pentru noua tendință enumerând asistentul său virtual Copilot și o nouă cheie Copilot ca cerințe pentru toate PC-urile AI. Cu toate acestea, Nvidia crede că GPU-urile sale RTX, care sunt pe piață din 2018, sunt mult mai potrivite pentru sarcinile AI, sugerând că NPUs-ul este inutil și că milioane de „PC-uri AI” sunt deja în circulație.

Microsoft susține că performanța AI de până la 40 de trilioane de operații pe secundă (TOPS) va fi necesară pentru PC-urile AI de nouă generație, dar prezentarea Nvidia susține că GPU-urile RTX pot ajunge deja la 100-1,300 TOPS. Producătorul de GPU-uri a declarat că chip-urile precum seria RTX 30 și 40 sunt instrumente excelente pentru crearea de conținut, productivitate, chatbot-uri și alte aplicații care implică numeroase modele de limbaj mari. Pentru astfel de sarcini, GeForce RTX 4050 mobil se presupune că poate depăși procesorul Apple M3, iar RTX 4070 desktop atinge performanțe de vârf în Diffuzia Stabilă 1.5.

Pentru a evidenția capacitățile unice ale tehnologiei sale, Nvidia a lansat o actualizare majoră pentru ChatRTX. Acest chatbot, alimentat de TensorRT-LLM al Nvidia, funcționează local pe orice PC echipat cu un GPU din seria RTX 30 sau 40 și minimum 8 GB VRAM. Ceea ce diferențiază ChatRTX este capacitatea sa de a răspunde la întrebări în mai multe limbi scanând documente sau liste de redare YouTube furnizate de utilizatori. Este compatibil cu formatele text, pdf, doc, docx și XML.

Desigur, faptul că Nvidia afirmă că este liderul sigur în performanța AI la nivel local nu înseamnă că competitorii vor arunca prosopul și vor spune: „Ai câștigat”. Dimpotrivă, concurența și cercetarea și dezvoltarea în piața NPUs vor deveni din ce în ce mai acerbe pe măsură ce companiile încearcă să detroneze Nvidia.